[벡트 AI테크 블로그] 인공지능과 딥러닝 혁신의 주춧돌, "Attention Is All You Need" 논문 심층 해설

딥러닝의 혁신, "Attention Is All You Need" 논문

2017년은 인공지능 분야, 특히 자연어 처리(NLP) 분야에서 중요한 전환점이 된 해입니다. Google의 저명한 연구진 8명이 발표한 "Attention Is All You Need"라는 제목의 획기적인 논문은 기존의 순환 신경망(RNN)과 컨볼루션 신경망(CNN)에 의존하던 시퀀스 변환 모델의 패러다임을 근본적으로 바꾸었습니다. 이 논문은 오직 어텐션 메커니즘만을 기반으로 하는 새로운 딥러닝 아키텍처인 트랜스포머를 제시하며, 기계 번역을 비롯한 다양한 시퀀스-투-시퀀스(Seq2seq) 작업에서 놀라운 성능 향상을 이루어냈습니다. 이 연구는 현대 인공지능의 핵심 토대가 되었으며, 오늘날 거대 언어 모델(LLM)의 주류 아키텍처로 자리매김했습니다.

- 논문의 링크 : https://arxiv.org/abs/1706.03762

이 논문의 발표는 당시 시퀀스 모델링 분야에서 지배적인 접근 방식에 대한 과감한 도전이었습니다. 순환 구조의 한계, 특히 긴 시퀀스에서의 정보 손실 문제와 병렬 처리의 어려움을 극복하고자 하는 연구자들의 끊임없는 노력이 결실을 맺은 것입니다. 여덟 명의 저자, 즉 Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan Gomez, Łukasz Kaiser, 그리고 Illia Polosukhin은 모두 이 연구에 동등하게 기여했으며, 저자 목록의 순서는 무작위로 결정되었다는 점이 흥미롭습니다. 이는 그들의 협력적인 연구 과정을 엿볼 수 있는 대목입니다.

더욱 흥미로운 점은 논문의 제목이 비틀즈의 유명한 노래 "All You Need Is Love"에서 영감을 받았다는 사실입니다. 또한, 트랜스포머라는 이름은 저자 중 한 명인 Jakob Uszkoreit이 단순히 그 단어의 울림이 좋아서 선택했다는 비화도 전해집니다. 이러한 배경 이야기는 딱딱하게 느껴질 수 있는 기술 논문에 인간적인 매력을 더합니다.

본 보고서는 "Attention Is All You Need" 논문의 핵심 내용을 심층적으로 분석하고, 연구 목적, 방법론, 주요 결과 및 결론을 자세히 설명하고자 합니다. 또한, 이 연구가 딥러닝 및 자연어 처리 분야에 미친 지대한 영향과 그 의미를 다각적으로 조명할 것입니다. 더 나아가, 관련 배경 정보와 추가적인 설명을 통해 독자들의 이해를 돕고, 트랜스포머 아키텍처의 현재와 미래 전망까지 논의할 것입니다.

논문의 핵심 내용 심층 분석

트랜스포머 아키텍처의 등장은 기존 시퀀스 모델링 방식의 근본적인 한계를 극복하고자 하는 강력한 동기에서 비롯되었습니다. 이전까지 자연어 처리 분야에서 뛰어난 성능을 보여왔던 순환 신경망(RNN) 기반 모델들은 긴 시퀀스를 처리하는 데 어려움을 겪었습니다. RNN은 입력 시퀀스를 순차적으로 처리하며, 이전 단계의 정보를 다음 단계로 전달하는 방식으로 작동합니다. 이러한 순차적인 특성은 긴 문장이나 문서와 같이 시퀀스 길이가 길어질수록 초기 정보가 희석되거나 소실되는 장기 의존성 문제를 야기했습니다. 또한, RNN의 구조적인 특성상 병렬 처리가 어려워 대규모 데이터셋을 활용한 효율적인 학습에 제약이 있었습니다.

컨볼루션 신경망(CNN) 역시 시퀀스 모델링에 활용되었지만, 넓은 범위의 문맥 정보를 파악하기 위해서는 여러 계층을 쌓아야 했고, 이는 모델의 복잡성을 증가시키는 요인이 되었습니다. 이처럼 기존 모델들이 가진 근본적인 약점들을 해결하고, 더 길고 복잡한 시퀀스를 효과적으로 처리하며, 동시에 병렬 처리를 통한 학습 효율성을 높이는 새로운 아키텍처에 대한 필요성이 꾸준히 제기되어 왔습니다.

이러한 배경 속에서 "Attention Is All You Need" 논문은 순환 구조나 컨볼루션 연산 없이 오직 어텐션 메커니즘만을 사용하여 입력 시퀀스의 각 위치에 대해 다른 위치와의 관련성을 계산하고, 이를 통해 중요한 정보에 집중하는 혁신적인 접근 방식을 제시했습니다. 어텐션 메커니즘은 입력 시퀀스 내의 단어들 간의 거리에 상관없이 직접적인 연결을 형성하여 장거리 의존성을 효과적으로 모델링할 수 있도록 합니다. 이는 모델이 문맥 전체를 파악하고, 각 단어의 의미를 정확하게 이해하는 데 결정적인 역할을 합니다. 다시 말해, 모델이 각 단어를 처리할 때, 전체 입력 시퀀스에서 가장 관련 있는 부분에 집중할 수 있게 함으로써, 정보 손실 없이 긴 문맥을 이해하는 능력을 크게 향상시킨 것입니다.

연구 목적 및 방법론 상세 해설

"Attention Is All You Need" 논문의 주요 연구 목표는 기계 번역 분야에서 당시 최고 성능을 자랑하던 모델들을 능가하는 동시에, 훈련 속도와 효율성을 획기적으로 개선할 수 있는 새로운 시퀀스 변환 모델을 개발하는 것이었습니다. 연구진은 트랜스포머 아키텍처를 통해 이러한 목표를 달성했을 뿐만 아니라, 이 기술이 질문 응답, 텍스트 요약, 심지어 이미지 생성과 같은 다양한 Seq2seq 작업에도 적용될 수 있는 잠재력을 제시했습니다. 기계 번역이라는 구체적인 과제를 통해 모델의 성능을 입증하고, 더 나아가 다양한 분야로의 확장 가능성을 보여주고자 한 것입니다.

표1 : 트랜스포머 아키텍처의 주요 구성 요소

| 구성 요소 | 설명/목적 | 주요 개념/수식 |

|---|---|---|

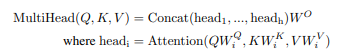

| 멀티 헤드 어텐션 | 여러 개의 독립적인 어텐션 헤드를 병렬로 사용하여 다양한 관점에서 입력 시퀀스 내 관계 포착 | 병렬적인 스케일드 닷-프로덕트 어텐션 연산 |

| 셀프 어텐션 | 동일한 입력 시퀀스 내 서로 다른 위치 간의 관계 모델링 | 쿼리, 키, 값이 동일한 입력에서 유래 |

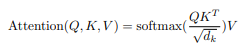

| 스케일드 닷-프로덕트 어텐션 | 어텐션 가중치 계산 방법 | Attention(Q, K, V ) = softmax( QKT / √dk )V |

| 포지셔널 인코딩 | 시퀀스의 순서 정보를 모델에 주입 | 사인 및 코사인 함수 기반 벡터 |

| 레이어 정규화 | 각 서브 레이어 이후 학습 안정화 | LayerNorm(x + Sublayer(x)) |

| 잔차 연결 | 깊은 네트워크 학습 도움 | 각 서브 레이어 입력과 출력 직접 연결 |

| Q, K, V 계산 | 입력 임베딩에서 쿼리, 키, 값 벡터 생성 | 입력 임베딩에 학습 가능한 가중치 행렬 곱셈 |

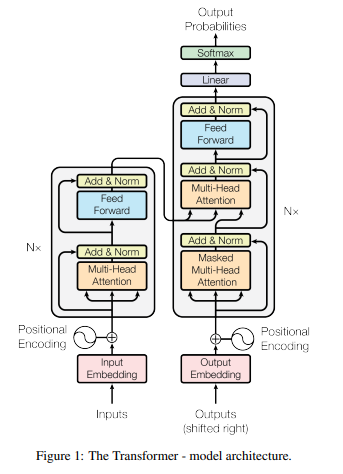

트랜스포머 모델의 핵심은 인코더와 디코더라는 두 개의 주요 구성 요소로 이루어진다는 점입니다. 인코더는 입력 시퀀스(예: 번역하고자 하는 원어 문장)를 받아 내부적인 표현으로 변환하는 역할을 합니다. 반면, 디코더는 인코더가 생성한 이 표현을 기반으로 목표 시퀀스(예: 번역된 문장)를 단계별로 생성합니다. 흥미로운 점은 인코더와 디코더 모두 여러 개의 동일한 레이어를 쌓아 구성된다는 것입니다. 논문에서는 실험적으로 6개의 레이어를 사용했습니다. 이러한 다층 구조는 모델이 입력 데이터에서 복잡한 특징들을 계층적으로 학습할 수 있도록 합니다.

트랜스포머 아키텍처의 핵심 혁신은 바로 멀티 헤드 어텐션 메커니즘입니다. 이는 여러 개의 독립적인 어텐션 헤드를 병렬로 사용하여 입력 시퀀스 내의 단어들 간의 관계를 다양한 관점에서 포착하는 방식입니다. 각 어텐션 헤드는 서로 다른 방식으로 입력 데이터를 변환하여, 모델이 특정 단어와 관련된 다양한 유형의 의미적, 문법적 관계를 동시에 학습할 수 있도록 합니다. 예를 들어, 하나의 헤드는 주어-동사 관계에 집중하는 반면, 다른 헤드는 형용사-명사 관계에 집중할 수 있습니다. 이러한 병렬적인 처리 방식은 모델의 표현력을 풍부하게 만들고, 더욱 정확한 문맥 이해를 가능하게 합니다.

셀프 어텐션은 트랜스포머에서 사용되는 어텐션 메커니즘의 특별한 형태입니다. 일반적인 어텐션이 서로 다른 두 시퀀스(예: 인코더의 출력과 디코더의 입력) 간의 관계를 모델링하는 데 사용되는 반면, 셀프 어텐션은 동일한 입력 시퀀스 내의 서로 다른 위치에 있는 단어들 간의 관계를 파악하는 데 사용됩니다. 인코더의 각 레이어와 디코더의 특정 레이어에서 활용되는 이 메커니즘을 통해 모델은 문장 내에서 각 단어가 어떤 다른 단어들과 관련이 있는지, 그리고 그 관련성이 얼마나 강한지를 학습할 수 있습니다. 이는 문맥을 이해하는 데 매우 중요한 역할을 합니다.

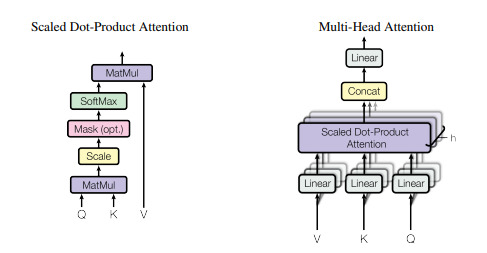

어텐션 가중치를 실제로 계산하는 방법으로 트랜스포머는 스케일드 닷-프로덕트 어텐션을 사용합니다. 이 방식은 입력 시퀀스의 각 단어에 대해 쿼리(Query), 키(Key), 값(Value)이라는 세 가지 벡터를 생성합니다. 쿼리는 특정 단어에 대한 "질문" 역할을 하고, 키는 다른 단어들의 "정보" 역할을 하며, 값은 해당 단어들이 가진 실제 "내용"을 나타냅니다. 특정 쿼리와 모든 키 벡터 간의 유사도(닷-프로덕트)를 계산한 후, 이 유사도 값들을 키 벡터의 차원 제곱근으로 나누어 스케일링하고, 소프트맥스 함수를 적용하여 가중치를 얻습니다. 이 가중치들은 값 벡터와 곱해져 최종적인 어텐션 출력을 생성합니다. 스케일링 과정은 닷-프로덕트 값이 너무 커져 소프트맥스 함수의 기울기가 소실되는 것을 방지하는 중요한 역할을 합니다. 수식으로 표현하면 다음과 같습니다:.

Attention(Q, K, V ) = softmax( QK^T / √dk )V. 여기서 dk는 키 벡터의 차원입니다.

트랜스포머는 순환 구조를 사용하지 않기 때문에, 시퀀스 내 단어의 순서 정보를 명시적으로 모델에 주입해야 합니다. 이를 위해 포지셔널 인코딩이라는 기법이 사용됩니다. 포지셔널 인코딩은 사인 함수와 코사인 함수를 사용하여 각 토큰의 위치 정보를 고유한 벡터 형태로 표현하고, 이를 단어 임베딩 벡터에 더하는 방식으로 이루어집니다. 이를 통해 모델은 각 단어가 시퀀스의 어느 위치에 있는지 인식할 수 있게 됩니다.

각 서브 레이어(멀티 헤드 어텐션과 포지션-와이즈 피드-포워드 네트워크) 이후에는 레이어 정규화와 잔차 연결이 적용됩니다. 잔차 연결은 각 서브 레이어의 입력과 출력을 직접 더해주는 방식으로, 기울기 소실 문제를 완화하고 깊은 네트워크의 학습을 돕습니다. 레이어 정규화는 각 레이어의 출력을 평균 0, 분산 1로 정규화하여 학습 과정을 안정화시키는 역할을 합니다. 수식으로 표현하면 LayerNorm(x + Sublayer(x))과 같습니다.

마지막으로, 쿼리(Q), 키(K), 값(V) 벡터는 단순히 입력 임베딩에서 생성되는 것이 아니라, 입력 임베딩에 학습 가능한 가중치 행렬(WQ, WK, WV)을 각각 곱하여 얻어집니다. 이러한 가중치 행렬은 모델이 학습 과정에서 최적의 값을 찾아가도록 조정되며, 입력 데이터의 다양한 측면을 포착하는 데 도움을 줍니다.

주요 연구 결과 및 결론 분석

"Attention Is All You Need" 논문은 제안된 트랜스포머 모델의 성능을 입증하기 위해 다양한 실험을 수행했습니다. 특히, 기계 번역 분야에서 주목할 만한 성과를 거두었습니다. 영어-독일어 번역 태스크(WMT 2014 English-to-German)에서 단일 모델로 27.5 BLEU(Bilingual Evaluation Understudy) 점수를 달성하여, 기존의 앙상블 모델을 포함한 최고 성능 모델들을 1 BLEU 포인트 이상 능가하는 결과를 보여주었습니다. 또한, 영어-프랑스어 번역 태스크(WMT 2014 English-to-French)에서는 41.0 BLEU 점수를 기록하며 이전 최고 성능의 단일 모델보다 0.7 BLEU 포인트 높은 성능을 나타냈습니다. 이러한 결과는 트랜스포머 모델이 기계 번역 분야에서 새로운 수준의 성능을 제시했음을 명확히 보여줍니다.

표 2: 트랜스포머와 기존 최고 성능 모델 비교

| 태스크 | 모델 | BLEU 점수 | 훈련 시간 | 파라미터 수 |

|---|---|---|---|---|

| 영어-독일어 번역 (WMT'14) | Transformer (단일 모델) | 27.5 | 약 12시간 | 165M |

| 영어-독일어 번역 (WMT'14) | 기존 최고 성능 앙상블 모델 | 26.3 | - | - |

| 영어-프랑스어 번역 (WMT'14) | Transformer (단일 모델) | 41.0 | 3.5일 | - |

| 영어-프랑스어 번역 (WMT'14) | 기존 최고 성능 단일 모델 | 40.3 | - | - |

뿐만 아니라, 트랜스포머 모델은 뛰어난 번역 품질을 달성했을 뿐만 아니라, 기존 모델 대비 훨씬 적은 훈련 시간과 비용으로 이러한 성과를 이루어냈다는 점이 더욱 중요합니다. 순환 구조를 사용하지 않고 병렬 처리가 가능한 트랜스포머의 특성 덕분에, 연구진은 8개의 P100 GPU를 사용하여 불과 12시간 만에 영어-독일어 번역 모델을 훈련할 수 있었습니다. 이는 당시 최고 성능을 기록했던 모델들의 훈련 시간에 비해 매우 짧은 시간입니다.

더욱 놀라운 점은 트랜스포머 모델이 기계 번역 외 다른 자연어 처리 태스크에서도 뛰어난 성능을 보였다는 것입니다. 예를 들어, 영어 구문 분석(English constituency parsing) 실험에서 트랜스포머는 별도의 태스크별 튜닝 없이도 높은 정확도를 기록했습니다. 이는 트랜스포머 아키텍처가 다양한 시퀀스 변환 문제에 대해 높은 범용성을 가질 수 있음을 시사합니다.

결론적으로, "Attention Is All You Need" 논문은 오직 어텐션 메커니즘만으로도 기존의 복잡한 순환 또는 컨볼루션 신경망 기반 모델들을 능가하는 강력하고 효율적인 시퀀스 변환 모델을 구축할 수 있음을 실증적으로 보여주었습니다. 특히, 병렬 처리 능력은 훈련 시간과 비용을 절감하는 데 크게 기여했으며, 이는 대규모 데이터셋을 활용한 모델 학습의 가능성을 열었습니다. 이러한 연구 결과는 이후 자연어 처리 연구의 방향을 근본적으로 바꾸는 중요한 계기가 되었습니다.

연구 결과의 의미와 영향력

"Attention Is All You Need" 논문이 발표된 이후, 트랜스포머 아키텍처는 자연어 처리 분야에서 혁명적인 변화를 가져왔습니다. 이 논문은 다양한 자연어 처리 태스크에서 새로운 성능 기준을 제시했으며, 이후 등장하는 수많은 연구들의 중요한 토대가 되었습니다. 특히, GPT(Generative Pre-trained Transformer), BERT(Bidirectional Encoder Representations from Transformers)와 같은 현재 가장 강력한 성능을 보이는 대규모 언어 모델(LLM)들은 모두 트랜스포머 아키텍처를 기반으로 하고 있습니다. 트랜스포머의 뛰어난 장거리 의존성 모델링 능력과 병렬 처리의 용이성은 이전에는 상상하기 어려웠던 수준의 자연어 이해 및 생성 능력을 가능하게 했습니다.

트랜스포머 아키텍처의 성공은 자연어 처리 분야뿐만 아니라 다른 다양한 분야에도 큰 영향을 미쳤습니다. 컴퓨터 비전 분야에서는 이미지를 시퀀스로 간주하고 트랜스포머를 적용하는 연구들이 활발히 진행되고 있으며, 이미지 분류, 객체 탐지 등 다양한 태스크에서 뛰어난 성능을 보이고 있습니다. 또한, 음성 인식, 시계열 데이터 분석 등 순차적인 데이터를 다루는 다양한 분야에서 트랜스포머의 변형 모델들이 활용되고 있습니다. 이는 어텐션 메커니즘이 순서 정보를 가진 데이터를 처리하는 데 매우 효과적인 일반적인 방법론임을 시사합니다.

"Attention Is All You Need" 논문은 단순히 새로운 모델 아키텍처를 제시한 것을 넘어, 인공지능 연구의 새로운 방향을 제시했다는 점에서 그 의미가 매우 큽니다. 순환 신경망에 대한 의존도를 줄이고, 어텐션 메커니즘의 중요성을 강조한 이 연구는 이후 자기 지도 학습(Self-Supervised Learning)과 대규모 모델 학습이라는 두 가지 중요한 흐름을 촉발시키는 데 결정적인 역할을 했습니다.

추가로 살펴볼 점

트랜스포머 모델의 핵심 구성 요소인 어텐션 메커니즘은 이 논문에서 처음 제시된 것은 아닙니다. 2014년 Bahdanau 등이 제안한 어텐션 메커니즘은 주로 순환 신경망 기반의 Seq2seq 모델에서 인코더와 디코더 간의 연결을 강화하고, 번역 과정에서 입력 시퀀스의 어떤 부분에 집중해야 할지를 결정하는 데 사용되었습니다. 하지만, 트랜스포머는 이러한 기존의 어텐션 메커니즘과는 근본적인 차이점을 가집니다. 가장 큰 차이점은 트랜스포머는 순환 구조나 컨볼루션 연산 없이 오직 어텐션 메커니즘만을 사용하여 시퀀스 내의 모든 위치 간의 관계를 직접적으로 모델링한다는 점입니다. 특히, 입력 시퀀스 내의 서로 다른 위치 간의 관계를 파악하는 셀프 어텐션이라는 개념은 트랜스포머의 핵심적인 혁신 중 하나입니다.

앞서 설명한 것처럼, 트랜스포머의 어텐션 메커니즘은 쿼리(Q), 키(K), 값(V)이라는 세 가지 주요 개념을 기반으로 작동합니다. 쿼리는 현재 처리하고 있는 특정 위치의 정보를 나타내고, 키는 전체 입력 시퀀스의 각 위치에 대한 식별자 역할을 하며, 값은 각 위치에 담긴 실제 정보를 의미합니다. 쿼리와 키 사이의 유사도를 계산하여 각 값에 대한 가중치를 결정하고, 이 가중치를 사용하여 값들을 선형 결합함으로써 최종적인 어텐션 출력을 얻습니다. 이는 마치 데이터베이스에서 쿼리를 사용하여 관련 키를 찾고, 해당 키에 연결된 값을 검색하는 과정과 유사하게 이해할 수 있습니다.

트랜스포머 아키텍처의 또 다른 중요한 장점은 바로 병렬 처리 능력입니다. 순환 신경망은 입력 시퀀스를 순차적으로 처리해야 하기 때문에 병렬 처리에 근본적인 제약이 있습니다. 반면, 트랜스포머는 어텐션 메커니즘을 통해 입력 시퀀스의 모든 위치를 동시에 처리할 수 있습니다. 이는 GPU와 같은 병렬 컴퓨팅 환경에서 학습 속도를 획기적으로 향상시키고, 더 큰 규모의 데이터셋과 모델을 효율적으로 학습할 수 있도록 합니다. 이러한 병렬 처리 능력은 트랜스포머가 대규모 언어 모델의 기반 아키텍처로 널리 채택되는 데 결정적인 요인이 되었습니다.

결론: 트랜스포머의 현재와 미래

"Attention Is All You Need" 논문은 딥러닝 기반 시퀀스 모델링 분야에 혁명적인 변화를 가져온 기념비적인 연구입니다. 이 논문은 순환 신경망과 컨볼루션 신경망 없이 오직 어텐션 메커니즘만으로도 뛰어난 성능을 달성할 수 있음을 입증했으며, 특히 병렬 처리 능력을 통해 학습 효율성을 크게 향상시켰습니다. 트랜스포머 아키텍처는 이후 자연어 처리 분야의 발전에 지대한 영향을 미쳤으며, 현재 대부분의 대규모 언어 모델의 핵심 기반 기술로 활용되고 있습니다.

트랜스포머 아키텍처는 발표 이후에도 끊임없이 발전하고 있으며, 다양한 변형 모델들과 새로운 어텐션 메커니즘들이 연구되고 있습니다. 예를 들어, 메모리 효율성을 개선하기 위한 연구, 더 긴 시퀀스를 처리하기 위한 연구 등 다양한 시도가 이루어지고 있습니다. 이러한 노력들은 트랜스포머 아키텍처가 앞으로도 자연어 처리뿐만 아니라 컴퓨터 비전, 음성 인식 등 다양한 분야에서 더욱 폭넓게 활용될 가능성을 보여줍니다. "Attention Is All You Need" 논문은 과거의 혁신일 뿐만 아니라, 미래 인공지능 기술 발전의 중요한 토대이자 영감을 제공하는 살아있는 연구 결과라고 할 수 있습니다.

벡트 소개

벡트는 하드웨어와 소프트웨어 모두를 아우르는 AI 전문기업입니다.

2024년 코스닥 시장에 상장한 벡트는 하드웨어 분야에서 오랫동안 축적해 온 디지털 사이니지에 대한 전문성과 역량을 통해 우리 사회와 산업의 디지털 전환을 선도하고 있습니다.

더불어 벡트는 AI 산업의 핵심 소프트웨어 기술과 응용 사업 역량을 빠르게 축적하고 있으며 이를 통해 다양한 AI 제품과 응용 어플리케이션들을 개발하고 있습니다.

앞으로도 벡트는 끊임없는 기술 혁신과 선도적인 사업 실행력을 바탕으로 디지털 사이니지 분야의 글로벌 AI 리더로서 고객과 함께 지속 성장하며 새로운 가치를 창출할 것입니다.